Réguler l’IA : Un Enjeu Mondial Crucial

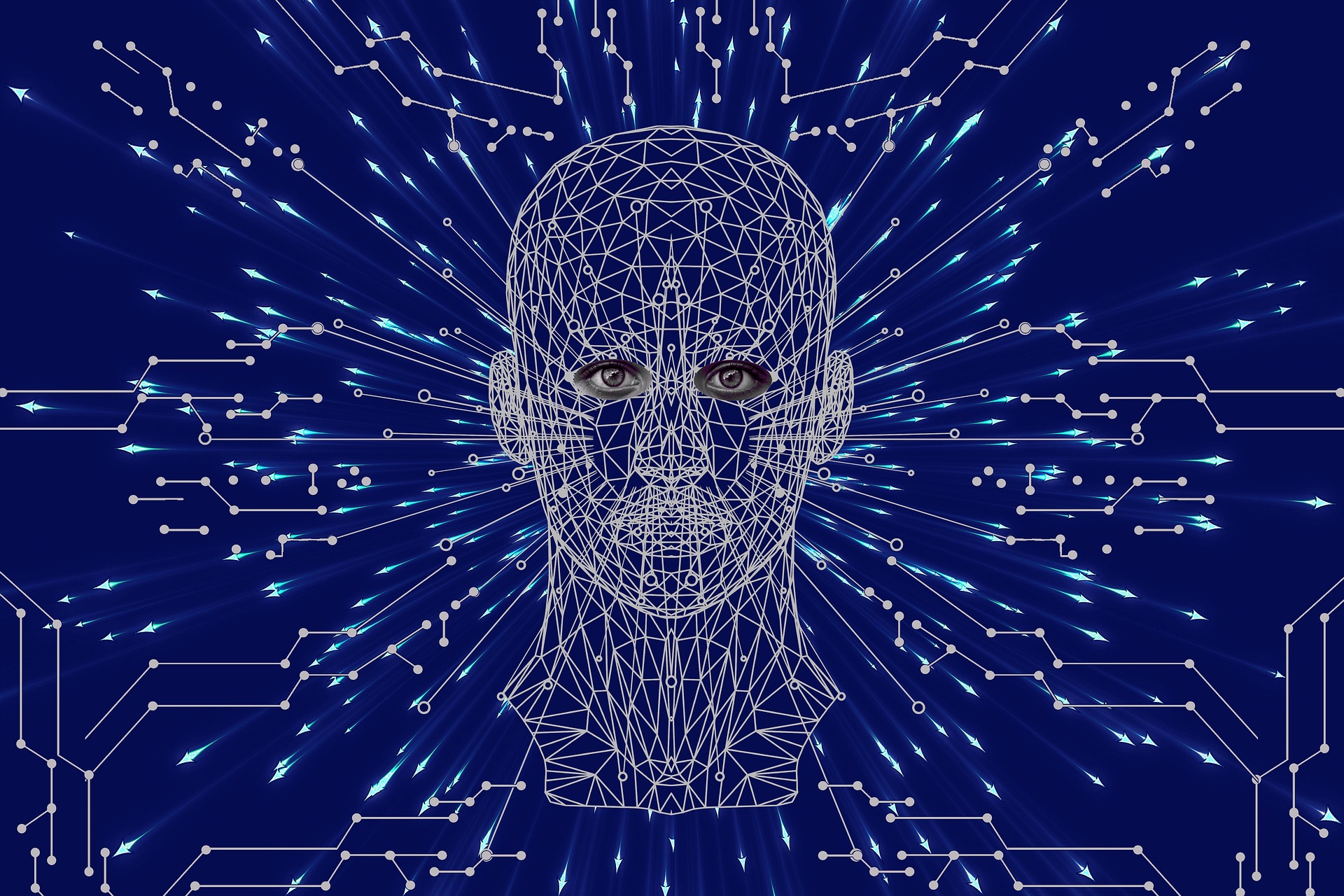

L’intelligence artificielle (IA) est partout. Elle compose des symphonies, rédige des articles, diagnostique des maladies, et bientôt, elle pourrait même prendre des décisions militaires. Mais derrière cette apparente révolution technologique se cache une réalité bien plus préoccupante : l’IA évolue plus vite que les cadres juridiques et éthiques censés la réguler. Alors que les géants technologiques se livrent à une course effrénée au profit, le reste du monde tente de rattraper son retard, laissant planer des risques colossaux pour nos sociétés.

Sommes-nous en train de perdre le contrôle de l’une des plus puissantes technologies jamais créées ?

Les risques d’un développement non régulé

1. Les biais algorithmiques : une menace insidieuse

L’IA n’est pas infaillible. Elle apprend à partir de données humaines, qui, par essence, sont biaisées. Lorsque ces biais se retrouvent intégrés dans des systèmes utilisés à grande échelle – qu’il s’agisse d’un algorithme de recrutement ou d’un logiciel de reconnaissance faciale – les discriminations existantes ne font qu’être amplifiées.

Prenons l’exemple des systèmes judiciaires. Aux États-Unis, certains logiciels prédictifs pèsent sur la probabilité qu’un individu récidive. Mais ces outils ont montré des préjugés raciaux flagrants, pénalisant davantage les minorités. Quand des décisions de justice reposent sur des algorithmes, qui assument la responsabilité des erreurs ?

2. La surveillance de masse : vers un Big Brother global

Certains États exploitent déjà l’IA pour surveiller leurs populations. La Chine, avec son système de notation sociale, en est l’exemple le plus connu. Grâce à des milliers de caméras équipées de reconnaissance faciale et à des bases de données massives, chaque citoyen est évalué en temps réel. Un comportement jugé inapproprié ? Votre score baisse, et avec lui, votre accès aux services publics ou au crédit.

La question qui se pose est simple : si l’IA est utilisée comme outil de contrôle, où s’arrêtera-t-on ? Et qui décidera de ce qui est « acceptable » ou non ?

3. Une arme sans frontières

L’un des aspects les plus inquiétants de l’IA réside dans son utilisation militaire. Des drones autonomes capables de prendre des décisions létales sans intervention humaine sont déjà en développement. Ces armes posent une question existentielle : peut-on déléguer des décisions de vie ou de mort à une machine ?

Sans régulation internationale, une course à l’armement technologique est inévitable, avec des conséquences potentiellement catastrophiques.

Les initiatives globales : des pas timides vers une régulation

1. L’Union Européenne : en première ligne

L’UE a pris les devants avec son AI Act, un projet législatif visant à encadrer les usages de l’IA selon leur niveau de risque. La reconnaissance faciale ou les systèmes de notation sociale, par exemple, seraient fortement restreints, voire interdits.

Mais cet effort européen est isolé. Sans coopération globale, ces lois risquent d’être inefficaces face aux entreprises et des États opérant en dehors de leur juridiction.

2. Des initiatives internationales encore embryonnaires

En dehors de l’Union européenne, les efforts de régulation sont encore balbutiants.

• L’UNESCO a lancé des appels à une régulation éthique de l’IA, notamment pour garantir que ces technologies respectent les droits humains fondamentaux. Mais ces initiatives manquent de caractère contraignant.

• Les Nations Unies ont timidement abordé l’usage militaire de l’IA, notamment à travers les discussions sur l’interdiction des « robots tueurs ». Mais aucune mesure globale n’a encore été adoptée.

Les grandes puissances, comme les États-Unis et la Chine, se montrent réticentes à participer pleinement à ces discussions. Ces nations, leaders du développement technologique, privilégient la compétitivité économique et militaire à court terme, au détriment d’une régulation mondiale.

Les défis d’une régulation efficace

1. La transparence des algorithmes : une boîte noire à ouvrir

L’un des obstacles majeurs à la régulation de l’IA est le manque de transparence des algorithmes. Souvent qualifiés de « boîtes noires », ces systèmes prennent des décisions sans que leurs mécanismes soient clairement compréhensibles, même pour leurs créateurs. Comment s’assurer qu’un algorithme n’est pas discriminatoire ou injuste si personne ne peut en examiner les rouages ?

2. La responsabilité juridique : qui doit répondre des erreurs ?

Si une IA cause un préjudice – par exemple, en refusant un prêt bancaire à tort ou en commettant une erreur médicale – qui doit en assumer la responsabilité ? L’entreprise qui a développé l’algorithme ? Celle qui l’a déployé ? Ou l’utilisateur final ?

Ce vide juridique pose un problème majeur pour la confiance dans l’IA et nécessite une définition claire des responsabilités.

3. Trouver un équilibre : réguler sans freiner l’innovation

Réguler l’IA est essentiel, mais une régulation trop stricte pourrait freiner les avancées technologiques et placer certaines régions du monde à la traîne. Comment trouver le juste milieu entre innovation et sécurité ?

Réflexion finale : Un avenir à définir, mais à quel prix ?

L’IA n’est pas simplement une invention technologique. C’est un miroir de nos valeurs, de nos ambitions, et de nos peurs. Elle nous promet de résoudre les crises climatiques, de soigner les maladies incurables, et de rendre nos vies plus confortables. Mais elle pourrait aussi devenir l’instrument d’un contrôle sans précédent, amplifiant les inégalités, détruisant des emplois, et façonnant des sociétés où la liberté n’est plus qu’une illusion.

La régulation de l’IA est donc bien plus qu’une question technique : c’est une question existentielle. Nous devons nous demander :

Voulons-nous d’un monde où les décisions les plus importantes – qu’il s’agisse de justice, de finance, ou même de vie et de mort – sont prises par des machines ?

Que signifie encore la démocratie si des algorithmes influencent nos choix, nos votes, et nos comportements sans que nous en ayons conscience ?

Sommes-nous prêts à déléguer notre autonomie à une technologie que seuls quelques-uns maîtrisent, et souvent dans un but lucratif ?

L’histoire nous enseigne que les grandes innovations technologiques, qu’il s’agisse de l’imprimerie ou de la révolution industrielle, ont toujours redistribué le pouvoir. Mais à quel prix ? La révolution numérique que nous vivons aujourd’hui pourrait bien être le tournant le plus décisif de l’histoire moderne.

Et si nous ne faisons rien ?

L’inaction serait la pire des réponses. En laissant les géants technologiques, ou quelques gouvernements, dicter les règles de l’IA, nous risquons de créer un monde profondément déséquilibré. Imaginez un monde où :

Les décisions économiques sont prises par des algorithmes qui permettent toujours les plus riches. La surveillance de masse devient la norme, rendant impossible toute dissidence. Les emplois créatifs, intellectuels et mêmes manuels disparaissent, remplacés par des IA toujours plus performantes.

Est-ce le monde dans lequel nous voulons vivre ?

Un avenir à construire ensemble

Mais il est encore temps d’agir. Réguler l’IA ne signifie pas freiner le progrès. Cela signifie l’encadrer, le façonner, et l’orienter vers un futur où les technologies servent l’intérêt collectif plutôt que d’accentuer les déséquilibres. Cela implique de poser les bonnes questions dès maintenant :

- Comment garantir que l’IA respecte nos valeurs fondamentales ?

- Qui doit avoir le pouvoir de surveiller, contrôler ou limiter l’utilisation de ces technologies ?

- Quels garde-fous devons-nous mettre en place pour protéger les plus vulnérables ?

L’IA est un outil puissant, mais c’est à nous, en tant que société, de décider comment l’utiliser. Devons-nous la réserver à une poignée d’élites ou l’ouvrir à des solutions collaboratives, éthiques et transparentes ?

La réponse à ces questions déterminera non seulement le visage du XXIᵉ siècle, mais aussi ce que nous voulons devenir en tant qu’humanité. Et cela commence par un sursaut collectif, une exigence de transparence, et une mobilisation citoyenne mondiale.

La question que je me pose est la suivante : quel avenir choisirons-nous pour l’intelligence artificielle ? Si nous restons passifs, l’IA risque de devenir le miroir de nos pires instincts : avidité, contrôle et domination. En revanche, si nous la guidons avec sagesse et courage, elle pourrait être le moteur d’un monde plus juste, ou innovation et humanité coexisterai harmonieusement.

L’avenir ne se construit pas tout seul. C’est une bataille à mener, un choix à faire. L’interrogation d’après moi est simple : serons-nous des spectateurs, ou des acteurs de cette révolution ?

Retrouvez-nous

sur vos réseaux